Wenn Deepfake-Röntgenbilder Ärzte täuschen: Die Gefahr aus der KI‑Werkstatt

Kernbefund: Deepfakes täuschen Experten

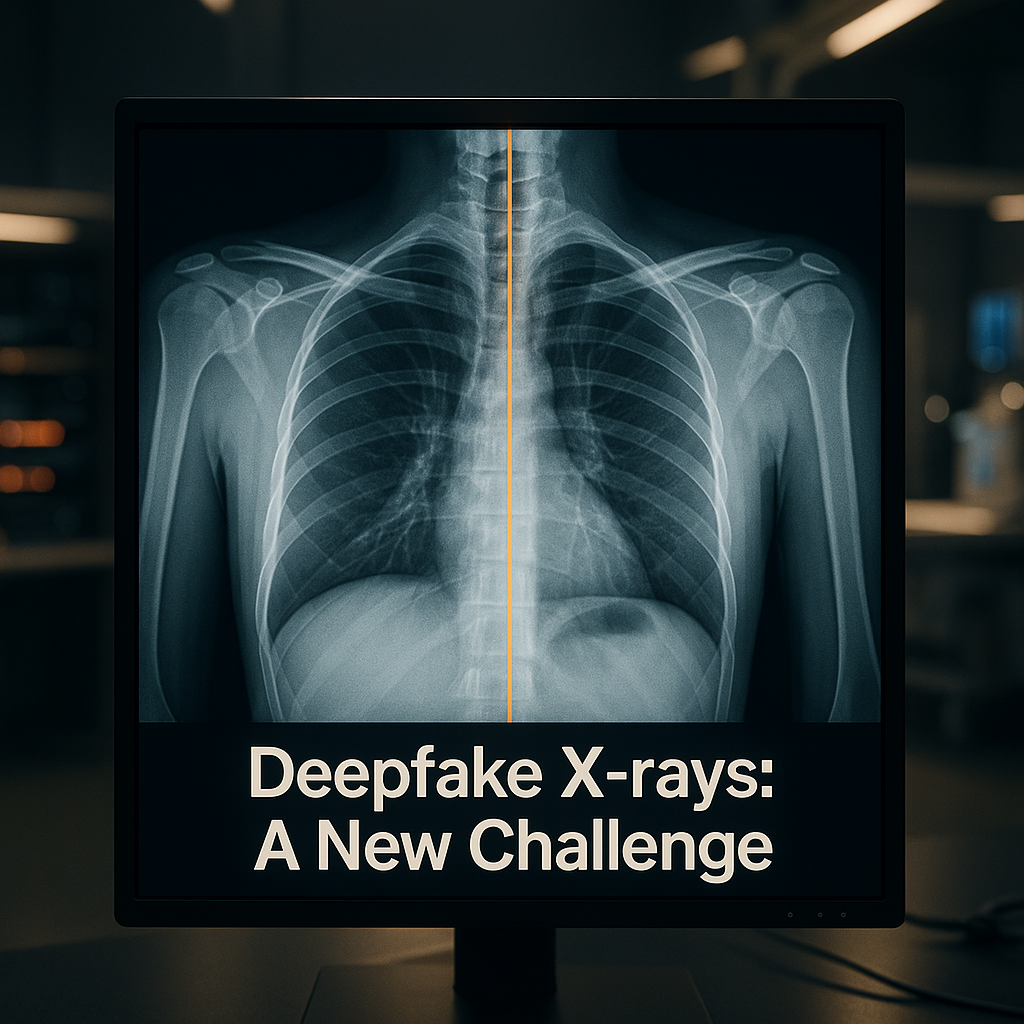

Am 24. März veröffentlichte das Journal Radiology eine Studie unter Leitung von Mickael Tordjman (Icahn School of Medicine at Mount Sinai), die 264 Röntgenaufnahmen untersuchte – je zur Hälfte echt und KI‑generiert. 17 Radiologinnen und Radiologen aus 12 Institutionen in sechs Ländern bewerteten die Bilder; ohne Vorwarnung erkannten sie nur 41 Prozent der synthetischen Aufnahmen, mit Hinweis auf Deepfakes stieg die Trefferquote auf 75 Prozent. Auch vier multimodale LLMs (darunter GPT‑4o, GPT‑5, Gemini 2.5 Pro und Llama 4 Maverick) lagen nur zwischen 57 und 85 Prozent Genauigkeit. Für mit RoentGen erzeugte Thoraxaufnahmen reichten die Erkennungsraten der Menschen von 62 bis 78 Prozent; die KI‑Modelle schwankten zwischen 52 und 89 Prozent.

Warum das für Patienten und Kliniken relevant ist

Die Studie macht deutlich, dass gefälschte medizinische Bilder nicht nur akademisches Problem sind: Ein fingierter Bruch oder manipuliertes Thoraxbild könnte in Gerichtsverfahren, bei Versicherungsansprüchen oder in Klinikakten massiven Schaden anrichten. Tordjman warnt vor einem hohen Risiko für Betrug und Cyberangriffe, etwa wenn Angreifer synthetische Bilder in Krankenhausnetzwerke einpflegen. Die Vertrauenswürdigkeit der digitalen Patientenakte stünde damit auf dem Spiel – mit direkten Folgen für Diagnose, Therapieplanung und rechtliche Auseinandersetzungen.

Technik und Erkennungsmerkmale

Die untersuchten Fälschungen stammten unter anderem von ChatGPT‑basierten Generatoren und von RoentGen, einem offenen Diffusionsmodell aus Stanford. Forscherinnen beobachteten charakteristische Muster in Deepfakes: Knochen wirken oft zu glatt, Wirbelsäulen unnatürlich gerade, Lungen ungewöhnlich symmetrisch und Frakturen auffallend sauber und einseitig. Interessanterweise korrelierte die Berufserfahrung nicht automatisch mit besserer Erkennungsfähigkeit; Fachleute für Muskuloskelettales schnitten jedoch deutlich besser ab als andere Sub‑Spezialisten.

Chancen, Gegenmaßnahmen und nächste Schritte

Die Autoren empfehlen technische Schutzmaßnahmen wie unsichtbare Wasserzeichen in Bildern und kryptografische Signaturen, die beim Zeitpunkt der Aufnahme an den zuständigen Technologen gebunden sind, sowie Trainingsdaten und Erkennungswerkzeuge für klinisches Personal. Als Bildungsangebot stellten die Forscher ein kuratiertes Deepfake‑Datenset mit interaktiven Quizzen bereit, um Sensibilität und Routine zu fördern. Zugleich warnen sie, dass die nächste Stufe bereits bevorstehen könnte: synthetische 3D‑Darstellungen wie CT und MRT würden die Herausforderungen noch verschärfen.

Würdest du einer digitalen Röntgenaufnahme ohne prüfbare Authentifizierung vertrauen?

Quelle: https://www.sciencedaily.com/releases/2026/03/260326011452.htm